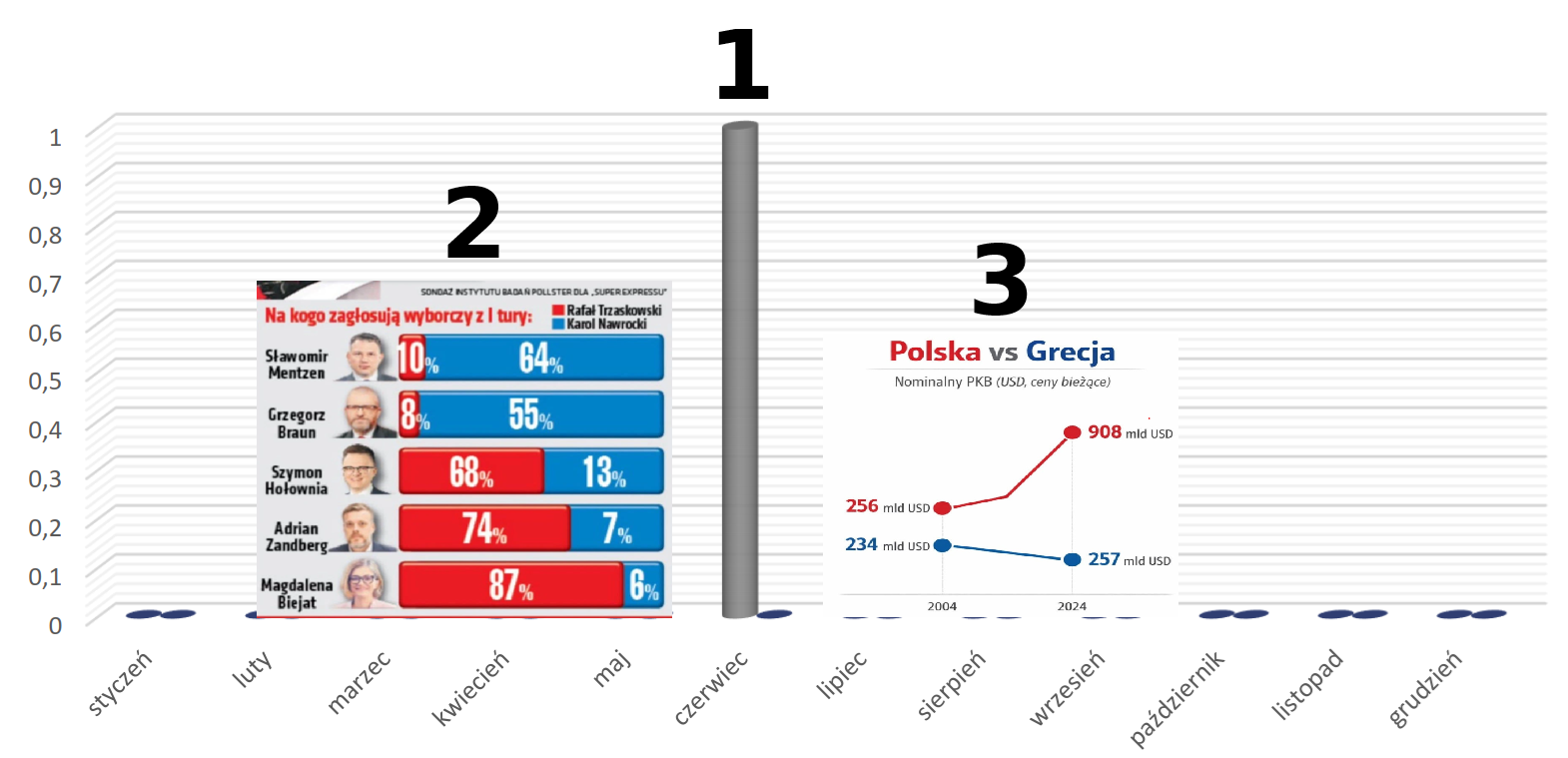

Podsumowanie plebiscytu na najgorszy wykres 2025 roku

Być może niektórzy czytelnicy pamiętają plebiscyty na najgorszy wykres roku, które prowadził profesor Przemysław Biecek. Niestety, parę lat temu przestał ...

Wizualizacja danych

O liczbach, które bolą.

Wizualizacja danych

Nuty to nie muzyka. Jak zamienić liczby w historię, która naprawdę wybrzmiewa.

Polska w liczbach

Ogólnodostępne dane dotyczące Polski

Analiza danych

Przepraszamy, nie znaleźliśmy żadnych wpisów.

Bądź na bieżąco

Zapisz się do naszego newslettera

Wizualizacja danych

Wizualizacja danych

Podsumowanie plebiscytu na najgorszy wykres 2025 roku

Być może niektórzy czytelnicy pamiętają plebiscyty na najgorszy wykres roku, które prowadził profesor Przemysław Biecek. Niestety, parę lat temu przestał ...

Piotr Szulc

03/07/2026

Wizualizacja danych

O liczbach, które bolą.

Technologicznie pędzimy naprzód. Planujemy kolonizację Marsa, a sztuczna inteligencja ma pomagać nam w rozwiązywaniu najbardziej złożonych problemów. Świat przyspiesza z ...

Paulina Sanak-Listwan

02/23/2026

Wizualizacja danych

Nuty to nie muzyka. Jak zamienić liczby w historię, która naprawdę wybrzmiewa.

Hans Rosling, mistrz data storytellingu, powiedział kiedyś, że wizualizacja danych jest jak patrzenie na nuty — samo ich oglądanie nie ...

Paulina Sanak-Listwan

02/20/2026

Polska w liczbach

Polska w liczbach

Ogólnodostępne dane dotyczące Polski

Liczba ogólnodostępnych zbiorów danych jest w Polsce coraz większa — a liczba analiz, jakie można na ich podstawie wykonać, praktycznie ...

Make overs

Sorry, we couldn't find any posts. Please try a different search.

Make overs

Przepraszamy, nie znaleźliśmy żadnych wpisów.

Inżynieria danych

Przepraszamy, nie znaleźliśmy żadnych wpisów.